Lors de la troisième édition des LUDOVIALES, événement en ligne dédié aux usages du numérique éducatif, Christophe Batier de l’Université Lyon 1 a dressé un constat aussi lucide qu’inquiétant : l’intelligence artificielle ne se contente pas de transformer les outils, elle redéfinit en profondeur la valeur des compétences humaines et met sous tension les fondements mêmes de l’enseignement.

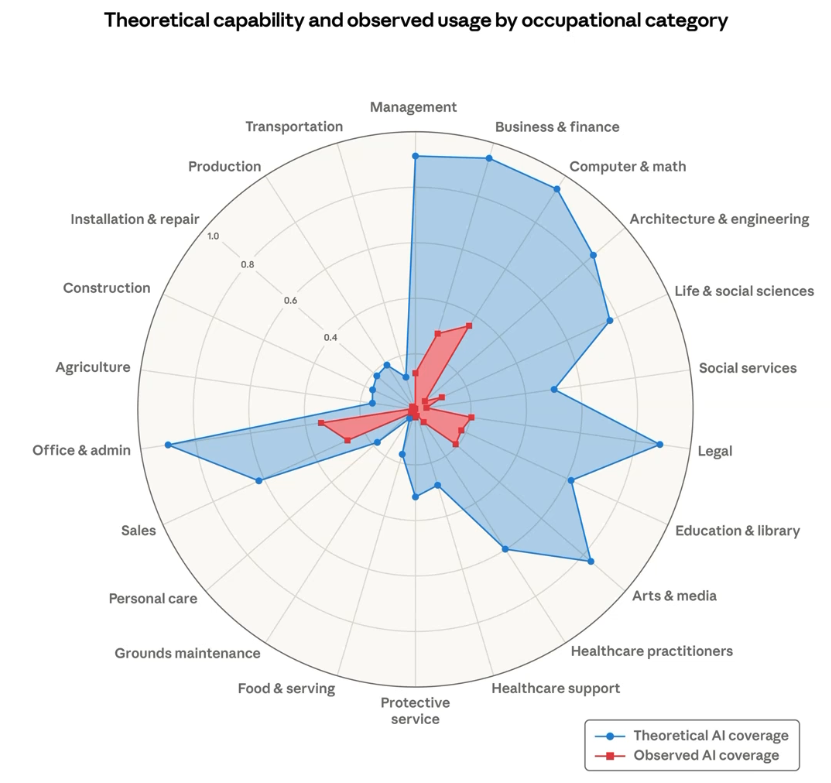

D’emblée, Christophe Batier invite à renverser une idée reçue. Là où les révolutions technologiques précédentes remplaçaient d’abord les tâches répétitives, l’IA, elle, s’attaque directement aux compétences qualifiées. Dans le domaine du développement informatique, par exemple, « écrire du code devient une commodité ». Autrement dit, ce qui constituait hier le cœur du métier perd de sa rareté. « Si la valeur d’un codeur repose sur sa capacité à écrire du code que l’IA produit plus vite, alors cette compétence n’est plus rare, elle est partout », souligne-t-il.

On ne va plus manquer de codeurs, mais de gens capables de penser avant de coder

Ce déplacement de valeur bouleverse les attentes des entreprises. Le développeur de demain ne sera plus seulement un technicien, mais un concepteur capable de comprendre un besoin, d’interpréter une demande et d’anticiper un environnement complexe. « On ne va plus manquer de codeurs, mais de gens capables de penser avant de coder », insiste Christophe Batier. Une évolution qui dépasse largement le seul secteur informatique. Dans le domaine juridique, par exemple, les tâches traditionnellement confiées aux jeunes recrues — analyser des dossiers, produire des synthèses, repérer des incohérences — sont désormais largement automatisables. Conséquence : les recrutements de profils juniors reculent, parfois de manière spectaculaire.

Cette transformation a des effets très concrets sur l’insertion professionnelle. Le modèle classique — formation, diplôme, emploi — se fragilise. Aux États-Unis, la part des titulaires de master parmi les demandeurs d’emploi atteint un niveau inédit. « Le diplôme n’est plus une garantie d’emploi », observe la recherche, pointant également une pression à la baisse sur les salaires des jeunes diplômés.

Face à ces mutations, les étudiants eux-mêmes adaptent leurs pratiques, parfois de manière brutale. En 2024, tous ceux interrogés par une enquête universitaire utilisaient une intelligence artificielle, souvent pour déléguer leurs travaux. « On paie parce que ça fait le boulot à notre place », reconnaissaient certains. Mais un an plus tard, le discours évolue. Les usages se diversifient, les outils se multiplient, et une forme de prudence s’installe. « Il ne faut pas que l’IA fasse le travail à ma place, il faut qu’elle m’aide », affirment désormais plusieurs étudiants. Une prise de conscience rapide, nourrie par la perception d’un marché du travail plus exigeant.

Il ne faut pas que l’IA fasse le travail à ma place, il faut qu’elle m’aide

C’est précisément sur ce point que le système éducatif se trouve aujourd’hui en difficulté. Les compétences attendues évoluent, mais les méthodes d’enseignement et d’évaluation peinent à suivre. « Les compétences sur lesquelles on doit évaluer nos étudiants sont en train de changer », explique Christophe Batier. Or, nombre d’exercices académiques — rédaction, analyse, synthèse — peuvent désormais être réalisés par une machine, parfois avec une qualité supérieure à celle des étudiants eux-mêmes. Cette situation crée un profond déséquilibre.

Plus encore, c’est la philosophie de l’université qui est interrogée. Depuis le XIXe siècle, l’enseignement supérieur repose sur des principes fondamentaux : développer l’esprit critique, encourager une pensée originale, former des individus autonomes capables d’affronter l’imprévisible. Or, selon Christophe Batier, l’IA entre en tension avec chacun de ces objectifs. « Elle produit une pensée moyenne, probabiliste, basée sur ce qui existe déjà. Elle ne génère pas de pensée critique ni véritablement originale », analyse-t-il.

Le choc est particulièrement visible autour de l’écriture, pilier historique de la formation universitaire. Mémoire, thèse, dissertation : autant d’exercices qui visent à structurer la pensée. Mais que devient cette exigence lorsque les textes peuvent être générés automatiquement ? Un cas récent à la Université Paris-Sorbonne illustre ce flou : une étudiante a obtenu la validation de son mémoire malgré des soupçons d’usage d’IA, faute de cadre réglementaire clair. « On ne peut pas prouver que c’est l’IA, mais on ne peut pas non plus garantir que c’est l’étudiant », résume la situation.

L’IA produit une pensée moyenne, probabiliste, basée sur ce qui existe déjà. Elle ne génère pas de pensée critique ni véritablement originale

Dans ce contexte, les enseignants se retrouvent en première ligne. Comment évaluer des compétences que les machines maîtrisent ? Comment s’assurer que le travail rendu reflète une pensée personnelle ? Et surtout, quelles compétences faut-il désormais transmettre ? « Cela fait trente ans que je forme mes étudiants de la même façon, et là, quelque chose a changé », confie Christophe Batier.

Des pistes émergent néanmoins. L’une d’elles consiste à repenser l’usage de l’IA non pas comme un substitut, mais comme un outil de co-construction. Il s’agirait d’amener les étudiants à formuler d’abord leur propre réflexion, avant d’interagir avec la machine pour enrichir, questionner ou structurer leur pensée. « Si l’on délègue tout à l’IA, il n’y a plus d’apprentissage. Si l’on réfléchit avec elle, il peut se passer quelque chose d’intéressant », explique Christophe Batier.

Si l’on délègue tout à l’IA, il n’y a plus d’apprentissage. Si l’on réfléchit avec elle, il peut se passer quelque chose d’intéressant

Mais cette transformation ne se limite pas aux pratiques pédagogiques. Elle engage une réflexion plus large sur le sens même de l’éducation. L’université n’a pas seulement pour mission de transmettre des compétences techniques, mais aussi de former des citoyens capables de jugement, de responsabilité et d’engagement. Or, l’usage massif d’outils automatisés pose une question fondamentale : comment construire une pensée personnelle dans un environnement où les réponses sont déjà produites ?

Au-delà de l’école, c’est toute la société qui est concernée. L’innovation technologique, autrefois perçue comme un progrès, suscite désormais des interrogations croissantes. « Pour beaucoup d’étudiants, l’innovation n’est plus synonyme de progrès, mais de contraintes, de pollution ou d’inégalités », note Christophe Batier. L’intelligence artificielle, en amplifiant ces tensions, oblige à repenser les finalités du développement technologique.

Au fond, la question posée par cette révolution dépasse largement celle des métiers ou des outils. Elle touche à ce que l’on attend de l’humain dans un monde où la machine peut simuler une grande partie de ses capacités cognitives. Comme il le résume : « Le problème n’est pas le code, c’est un problème de décision ».

Une phrase qui résonne comme un avertissement : à mesure que l’intelligence artificielle progresse, la véritable compétence devient moins technique que profondément humaine.